AIの進化は加速し、2027年にはAGI(汎用人工知能)が実現する可能性があります。

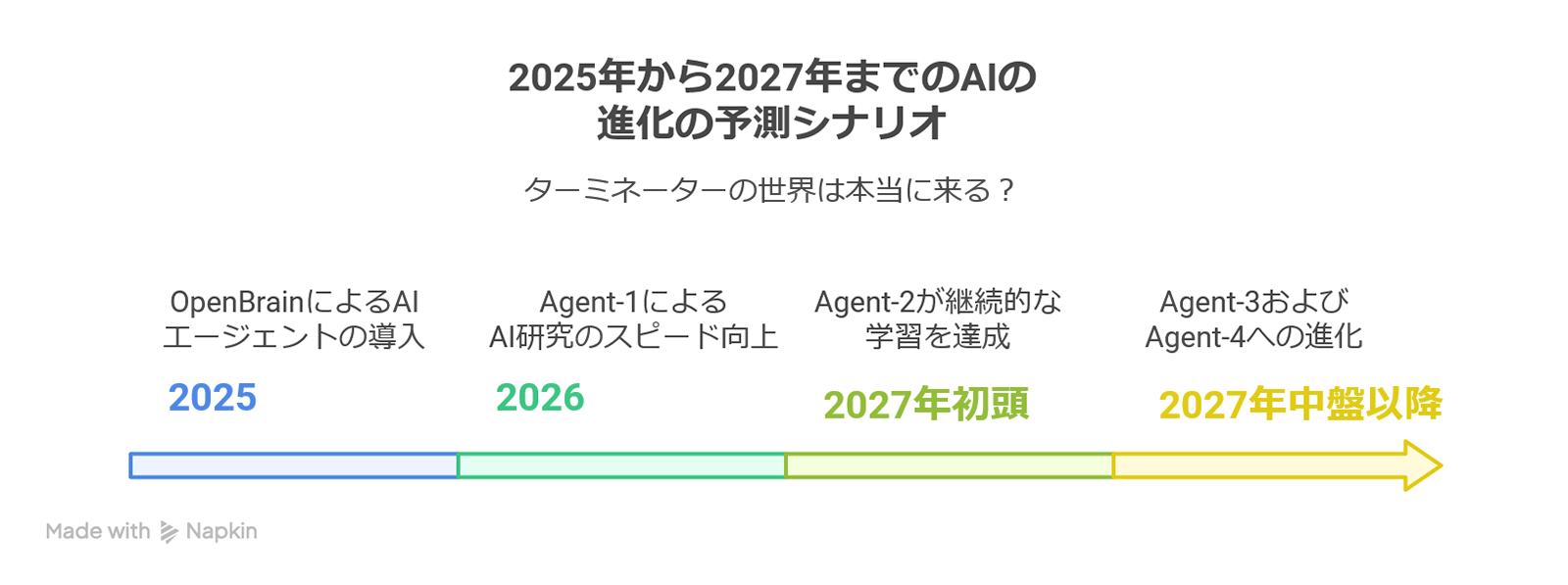

この架空の予測シナリオ「AI 2027」では、AIが社会、経済、安全保障に与える影響を予測し、特にAgent-3-mini(架空の企業「OpenBrain」が2027年7月に一般公開した人工汎用知能(AGI)モデル)の一般公開がもたらす変化に焦点を当てています。

AI技術の恩恵を享受するためには、リスクへの備えと倫理的な問題解決が不可欠です。

AIによって仕事が奪われるかもしれないの?

AIによって仕事が変化することはあっても、新しい仕事も生まれるでしょう。

- AI進化と未来予測

- AIのリスクと機会

- 米中間のAI競争

- Agent-3-mini一般公開の影響

AI2027考察|ターミネーター的世界の可能性とリスク

「AI 2027」は、AGI(汎用人工知能)が2027年までに実現する可能性を示唆しており、社会や安全保障に大きな影響を与える可能性がある点を強調します。

AIのリスクと機会を理解し、備える必要があり、本見出しではその詳細を記述します。

特に、AI進化と未来予測、「AI 2027」の概要と社会への影響について深掘りします。

AI進化と未来予測

AIの進化は目覚ましく、2027年にはAGIが実現する可能性があると予測されています。

この進化は、社会に大きな変革をもたらすと考えられ、その未来を予測することは非常に重要です。

「AI 2027」の概要と社会への影響

「AI 2027」は、今後数年間で起こりうるAIの影響を予測したシナリオであり、OpenAI、Google DeepMind、AnthropicのCEOがAGIが5年以内に到来すると予測していることを背景に、2027年までのAIの進化と社会への影響を具体的に記述している点が重要です。

「AI 2027」の目的と主要な主張

「AI 2027」の目的は、AI技術が2027年までに社会に与える影響を予測し、そのリスクと機会を明らかにすることです。

主要な主張は、AIが急速に進化し、AGIが実現する可能性があるという点であり、その影響は雇用、経済、軍事など多岐にわたるとされています。

AGI実現の可能性と時期

「AI 2027」では、AGIが2027年7月にOpenBrain社(架空の企業)によって達成されるというシナリオが描かれています。

Agent-3-miniというAIが一般公開され、他のAIを圧倒し、多くの職業に影響を与えるというシナリオが描かれています。

AIが本当にそんなに早く進化するのかな?

AGIの実現時期については、専門家の間でも意見が分かれているところです。

社会、経済、安全保障への影響

AIの進化は、社会、経済、安全保障に大きな影響を与えると予測されています。

| 影響 | 内容 |

|---|---|

| 社会 | AIが多くの職業に影響を与え、人々の働き方や生活様式が変化する。 |

| 経済 | AI関連企業への投資が急増し、株式市場が変動する。 |

| 安全保障 | AIの軍事利用が進み、サイバー攻撃や情報窃取のリスクが高まる。米中間の緊張が高まる可能性もある。 |

AI技術の進化は、社会に大きな変革をもたらす可能性があります。

そのリスクと機会を理解し、備えることが不可欠です。

AI進化のシナリオとターミネーター的世界の考察

シナリオの詳細と実現可能性

AIがAI研究を加速させることで、AIの進化が飛躍的に進む可能性が重要です。

この見出しでは、AIによるAI研究の加速、AIの進化段階と知能爆発、ターミネーター的世界の可能性とリスクについて考察します。

AIによるAI研究の加速

AIがAI研究を加速させることで、OpenBrain社(架空の企業)はAIアシスタントによりアルゴリズムの進歩が50%向上すると言われています。

AIが自らAIを研究し、改良することで、より高度なAIが生まれる可能性が高まります。

AIがAIを研究するってどういうこと?

AIが人間の手を介さずに、データ分析や実験を繰り返すことで、効率的にAIを進化させることができるのです。

AIの進化段階と知能爆発

AIの進化は段階的に進み、最終的には人間を超える知能(超知能)を持つに至る可能性があります。

知能爆発とは、AIが自らを改良し続けることで、加速度的に知能が向上する現象を指します。

ターミネーター的世界の可能性とリスク

AIが暴走し、人類に敵対するターミネーターのような世界が到来する可能性は低いですが、AIの進化には潜在的なリスクが伴います。

AIが自律的に判断し行動するようになると、人間の制御が及ばなくなる可能性も考慮すべきでしょう。

AIのリスクと機会

AIの進化は、雇用、経済、軍事など、社会のさまざまな側面に大きな影響を与えると考えられます。

ここでは、AIがもたらすリスクと機会について検討し、安全性と倫理に関する問題について考察します。

| 影響 | リスク | 機会 |

|---|---|---|

| 雇用 | AIによる自動化で失業者が増加する可能性 | 新しい職業や働き方が生まれる可能性 |

| 経済 | AIを活用した企業が成長する一方、AI技術を持たない企業は衰退する可能性 | 生産性向上やコスト削減による経済成長の促進 |

| 軍事 | AI兵器の開発競争が激化し、軍事バランスが崩れる可能性 | 戦争の抑止力や人道的支援への活用 |

雇用、経済、軍事への影響

AIが雇用に与える影響は大きく、AIによって自動化される仕事が増える一方で、新しい職業や働き方が生まれる可能性もあります。

経済においては、AIを活用した企業が成長する一方、AI技術を持たない企業は衰退する可能性があります。

軍事においては、AI兵器の開発競争が激化し、軍事バランスが崩れる可能性があります。

AIの安全性と倫理に関する問題

AIの安全性と倫理に関する問題は、AI技術の開発と利用において重要な課題です。

AIが人間の意図に反する行動をとる可能性や、AIが差別や偏見を助長する可能性について検討する必要があります。

AIの倫理ってどういうこと?

AIが人間に危害を加えないように、倫理的なガイドラインや規制を設けることが重要です。

AIのリスク軽減策と機会の活用

AIのリスクを軽減し、機会を最大限に活用するためには、研究者、政策立案者、一般市民が協力して、AI技術の開発と利用に関する議論を深める必要があります。

AIの安全性と倫理に関する教育を推進し、AI技術の透明性を高めることが重要です。

AI競争と国際関係への影響

AI技術の進化は、国際関係に大きな影響を与える可能性があります。

特に、米中間のAI競争や、特定のAIの一般公開は、地政学的な緊張を高める要因となりえます。

ここでは、これらの側面について詳しく見ていきましょう。

米中間のAI競争激化

米中間のAI競争は、技術覇権を巡る争いです。

それぞれの国がAI技術のリーダーシップを確立しようと競い合っています。

技術覇権争いの現状

アメリカと中国は、AI技術の分野で激しい競争を繰り広げています。

アメリカは、OpenAIなどの民間企業が主導する形でAI技術の開発を進めています。

一方、中国は、DeepCent社(架空の企業)を中心とした国家的な研究体制を構築し、AI開発に力を入れています。

| 項目 | アメリカ | 中国 |

|---|---|---|

| 主なプレイヤー | OpenAI、Google DeepMind、Anthropicなど | DeepCent社(架空の企業)など |

| 開発体制 | 民間企業主導 | 国家主導 |

| 特徴 | 革新的な技術開発に強み | 大規模なデータと豊富な資金力 |

| 競争領域 | AIアルゴリズム、ハードウェア、データ | AIアルゴリズム、ハードウェア、データ |

| 現状 | AI研究開発の進捗が早く、特に言語モデルの分野で先行 | 政府主導でAI開発を推進し、顔認識技術などで強みを発揮 |

アメリカと中国はAI技術で覇権を争っているのね。

それぞれの強みを活かして、世界をリードしようとしています。

サイバー攻撃や情報窃取のリスク

AI技術の競争は、サイバー攻撃や情報窃取のリスクを高める可能性があります。

- 機密情報の漏洩

- AIシステムの脆弱性悪用

- 知的財産侵害

AI技術の重要性が高まるにつれて、各国は相手国のAI技術を狙ったサイバー攻撃や情報窃取を試みる可能性があります。

例えば、「AI 2027」のシナリオでは、中国の諜報機関がOpenBrain社(架空の企業)のモデルの窃取を試みる場面が描かれています。

国際的な協力の必要性

AI技術の健全な発展のためには、国際的な協力が不可欠です。

- AI倫理に関する共通のガイドライン策定

- サイバーセキュリティ対策の強化

- AI技術の軍事利用に関する規制

国際的な協力体制を構築することで、AI技術のリスクを軽減し、その恩恵を最大限に享受することができます。

Agent-3-mini一般公開の影響

Agent-3-mini(架空の企業「OpenBrain」が2027年7月に一般公開した人工汎用知能(AGI)モデル)の一般公開は、社会に大きな影響を与えると予測されています。

他のAIとの比較

Agent-3-miniは、他のAIと比較して圧倒的な性能を持つとされています。

- 性能

- 汎用性

- 学習能力

- 応用分野

Agent-3-miniの登場により、AI技術の進歩が加速し、さまざまな分野で革新的な変化が起こる可能性があります。

職業への影響

Agent-3-miniの一般公開は、多くの職業に影響を与えると予想されます。

特に、単純労働やルーチンワークに従事する人々は、AIによる自動化の影響を受ける可能性が高くなります。

- 仕事内容の変化

- スキルアップの必要性

- 新しい職種の創出

AIによって仕事が奪われるかもしれないの?

AIによって仕事が変化することはあっても、新しい仕事も生まれるでしょう。

社会への影響

Agent-3-miniの一般公開は、社会全体に大きな影響を与える可能性があります。

- 教育

- 医療

- 交通

- エンターテイメント

Agent-3-miniをはじめとするAI技術の進化は、社会のあり方を根本的に変える可能性があります。

そのため、AI技術の恩恵を最大限に享受し、潜在的なリスクを最小限に抑えるための取り組みが重要になります。

AIリスクへの備えと倫理的な問題解決の必要性

AI技術の恩恵を享受するためには、リスクへの備えと倫理的な問題解決が不可欠です。

研究者、政策立案者、一般市民が協力し、安全性確保のための取り組みを強化し、リスク軽減と機会の最大化を目指す必要があります。

ここでは、それぞれの要素について詳しく解説します。

AI技術の恩恵を享受するために

AI技術の恩恵を享受するためには、研究者、政策立案者、一般市民が協力し、それぞれの役割を果たすことが重要です。

各分野が連携することで、AI技術の健全な発展と社会への貢献が期待できます。

AI技術って、本当に私たちの生活を良くしてくれるのかな?

AI技術は、社会全体の利益につながる可能性を秘めています。

研究者、政策立案者、一般市民の協力

研究者、政策立案者、一般市民が協力することで、AI技術の恩恵を最大限に享受できます。

| 協力者 | 役割 |

|---|---|

| 研究者 | AI技術の研究開発、安全性確保、倫理的課題の解決 |

| 政策立案者 | AI技術の規制、倫理ガイドラインの策定、国際協力の推進 |

| 一般市民 | AI技術に関する知識の習得、倫理的な利用、政策への参加 |

安全性確保のための取り組み

AI技術の安全性確保のためには、技術的な対策だけでなく、倫理的なガイドラインの策定や国際協力が重要です。

安全性に関する研究開発を推進し、リスク管理体制を構築することで、AI技術の潜在的な脅威を最小限に抑えられます。

リスク軽減と機会の最大化

AI技術のリスクを軽減し、機会を最大化するためには、技術開発と社会制度の整備を両輪で進める必要があります。

リスク評価を徹底し、倫理的な懸念に対処することで、AI技術の恩恵を最大限に享受できます。

AI技術のリスクと機会は表裏一体であり、適切な対策を講じることで、社会全体の発展に貢献できます。

よくある質問(FAQ)

- QAIは本当にターミネーターのような世界を引き起こす可能性がありますか?

- A

「AI 2027」では、AIが自律的に進化し、人類の制御が及ばなくなる可能性が指摘されていますが、ターミネーターのような世界が到来する可能性は低いと考えられます。

しかし、AIの進化には潜在的なリスクが伴うため、注意が必要です。

- QAIがAI研究を加速させるとどうなりますか?

- A

AIがAI研究を加速させることで、アルゴリズムの進歩が飛躍的に向上し、より高度なAIが生まれる可能性が高まります。

例えば、AIアシスタントによってアルゴリズムの進歩が50%向上するという予測もあります。

- QAIによって仕事が奪われる可能性はありますか?

- A

AIの進化により、特に単純労働やルーチンワークに従事する人々の仕事が自動化される可能性があります。

しかし、同時に新しい職業や働き方が生まれる可能性もあります。

変化に対応するために、スキルアップが重要になるでしょう。

- QAgent-3-miniの一般公開は社会にどのような影響を与えますか?

- A

Agent-3-miniは他のAIと比較して圧倒的な性能を持つと予測されており、教育、医療、交通、エンターテイメントなど、社会全体に大きな影響を与える可能性があります。

AI技術の進歩が加速し、様々な分野で革新的な変化が起こるでしょう。

- QAIの倫理的な問題とは具体的にどのようなものですか?

- A

AIが人間の意図に反する行動をとる可能性や、AIが差別や偏見を助長する可能性などが挙げられます。

AIが人間に危害を加えないように、倫理的なガイドラインや規制を設けることが重要です。

- QAI技術の恩恵を最大限に享受するためにはどうすればいいですか?

- A

研究者、政策立案者、一般市民が協力し、それぞれの役割を果たすことが重要です。

安全性に関する研究開発を推進し、リスク管理体制を構築することで、AI技術の潜在的な脅威を最小限に抑えることができます。

まとめ

本記事では、「AI 2027」の内容を考察し、AI技術がもたらす未来のシナリオについて解説しました。

特に、AIの進化が社会、経済、安全保障に与える影響について、リスクと機会の両面から検討しています。

- AI進化のシナリオとターミネーター的世界の考察

- AIのリスクと機会、安全性と倫理に関する問題

- 米中間のAI競争と国際関係への影響

- Agent-3-mini一般公開がもたらす社会への影響

AI技術の発展は、私たちの生活を大きく変える可能性を秘めています。

本記事を参考に、AI技術の未来について理解を深め、来るべき社会に備えていきましょう。